Llevamos unos meses contemplando los riesgos de la IA generativa, pero todavía parece que solo hemos visto el principio de su potencial destructivo. Se han vuelto tan realistas que los estafadores ahora pueden utilizar a celebridades para sus anuncios sin su permiso, y sin que los usuarios puedan notar la diferencia. En esta ocasión, ha logrado engañar también a los moderadores de TikTok, ya que el anuncio se ha mostrado en su plataforma hasta que el creador ha denunciado el uso de su imagen.

El anuncio con IA de Mr. Beast

Como pudimos ver en profundidad en nuestro artículo, el creador de contenido más grande del mundo tiene una audiencia sin comparación, con 188 millones de suscriptores en su canal de YouTube. Precisamente su gran popularidad y su fama de hacer concursos y regalos de todo tipo es lo que le ha convertido en el blanco perfecto para los deepfakes. En el anuncio que se mostró en TikTok, aparecía Mr. Beast diciendo que regalaba a 10,000 usuarios un iPhone 15 por sólo 2 dólares. Si se tratase de cualquier otro famoso, nadie dudaría de que era una estafa, pero en este caso, el youtuber nos tiene acostumbrados a campañas de este tipo. No es raro en sus videos ver como regala grandes cantidades de dinero o coches de lujo a desconocidos, y por ello muchos no dudaron de que se trataba de una oferta real. Además, su forma de dirigirse a la cámara es igual que la del verdadero Mr. Beast, con su aspecto y su voz idénticos. Este es el gran riesgo que supone la IA con los deepfakes.

Y precisamente el anuncio era tan realista que logró eludir los controles que lleva a cabo TikTok para poder publicar anuncios en su plataforma. Normalmente, los anuncios deben pasar una inspección por parte de un moderador humano o una IA. Pero aquí es donde está lo surrealista de la situación. La IA de TikTok fue incapaz de detectar a otra IA que había creado el anuncio deepfake de Mr. Beast. La IA fraudulenta en esta ocasión fue más diestra que la IA moderadora de la red. Tan solo varias horas después de que estuviese visible en la plataforma fue el anuncio borrado porque vulneraba la política de publicidad de TikTok. Lo curioso es que muchas otras plataformas como Meta también usan moderadores con IA, por lo que existe un riesgo de que los deepfakes proliferen en el futuro. Al fin y al cabo, los creadores y anunciantes también usan la tecnología para crear anuncios muchas veces, por lo que su uso fraudulento es muy difícil de detectar.

Lots of people are getting this deepfake scam ad of me… are social media platforms ready to handle the rise of AI deepfakes? This is a serious problem pic.twitter.com/llkhxswQSw

— MrBeast (@MrBeast) October 3, 2023

Campañas de publicidad y de marketing con deepfakes

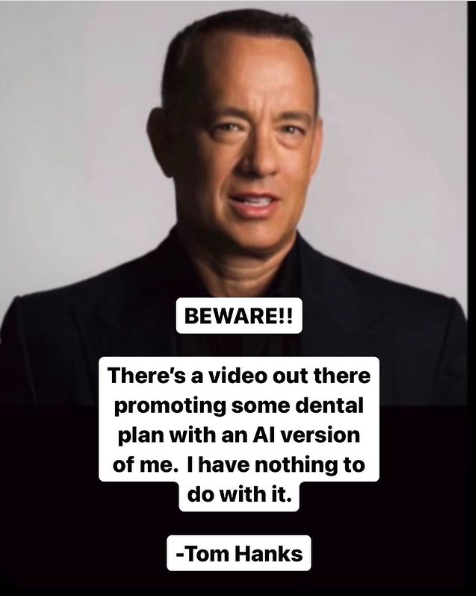

Aunque solo estuvo unas horas publicado, el engaño en el que aparecía Mr. Beast es probable que lograse estafar a varios usuarios. Además de perjudicar a los seguidores del creador, la campaña fraudulenta tiene un impacto negativo sobre su imagen y credibilidad. Y esto es lo que ha denunciado Jimmy Donaldson en sus redes, advirtiendo a sus fans y denunciado el peligro de los deepfakes. Porque Mr. Beast no es el único que se ha visto afectado por los deepfakes que se aprovechan de su imagen. Esta semana Tom Hanks y la presentadora de la CBS, Gayle King, también han denunciado anuncios en los que aparecía su imágen con la IA. Los expertos temen el daño que pueden hacer las campañas de marketing con deepfakes, pero también cómo pueden afectar de cara las elecciones. La dificultad para detectar que son imágenes generadas por la IA solo va aumentar según la tecnología siga mejorando.

Y este tipo de videos los puede crear prácticamente cualquiera precisamente por lo fácil que resulta utilizar las herramientas con IA. En solo unos meses, hemos visto la evolución de las imágenes falsas, como la del Papa Francisco, a los vídeos falsos. Mientras la legislación es incapaz de seguir el ritmo de las novedades tecnológicas, la IA está transformando el contenido online. Por un lado, se pueden utilizar imágenes falsas para tergiversar lo que dice cualquier persona y para crear desinformación de forma intencionada. Pero por otra parte, hace que las pruebas de video sean cada vez menos fiables. La IA también hace que se pueda desmentir la autoría de un contenido o desvincularse de sus consecuencias. En el futuro próximo, todo indica que veremos ejemplos de ambos. Esperemos que las estafas se limiten a los anuncios en TikTok, y no a los comunicados presidenciales. Pero estamos solo en el comienzo de la era de los deepfakes.