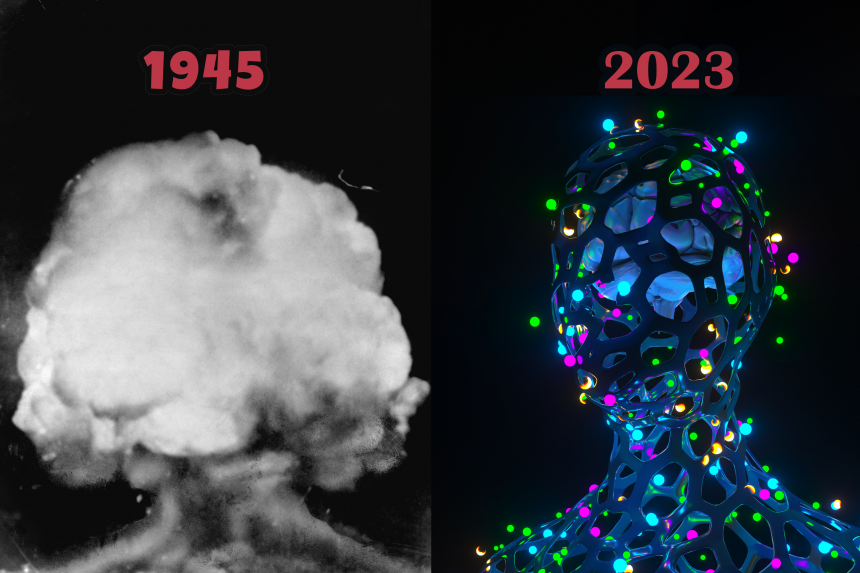

Los paralelismos entre estos dos acontecimientos históricos pueden parecer a primera vista remotos, pero los expertos demuestran que la bomba atómica y la IA comparten un camino muy similar. Más allá de los manifiestos apocalípticos, el debate invita a una reflexión muy constructiva sobre el futuro de la humanidad. Quizás sirva incluso para darle un necesario empujón a la regulación internacional de la IA.

Una tecnología que marca un antes y un después

El 16 de julio de 1945, a las 5:29 de la mañana, la primera bomba atómica de la historia fue detonada en Los Álamos. Segundos tras la explosión, el científico que había liderado el proyecto Manhattan, Robert Oppenheimer recitó la famosa frase del Bhagavad Gita: “Ahora me he convertido en la Muerte, la destructora de mundos”. El resto es historia, tal y como narra la brillante película de Christopher Nolan. Pero el director en este film que está triunfando en todo el mundo, va más allá y ahonda en la dura lucha que llevaron a cabo los científicos detrás de la bomba para expresar su opinión. En ese momento crítico de la historia, por primera vez los humanos tuvieron a su alcance una herramienta capaz de destruir el mundo. Los propios creadores de un poder tan desmesurado abogaron por frenar la peligrosa senda que se avecinaba con la carrera armamentística. Pero ni siquiera las mentes más brillantes del momento fueron capaces de transmitir la necesaria sensatez a los políticos del momento. Ahora esto parece estar sucediendo de nuevo, con preocupantes similitudes.

El 30 de noviembre de 2022 se lanzó Chat GPT, y su modelo de IA generativa revolucionó el mundo. Las capacidades de esta tecnología para crear texto y replicar tareas humanas ha supuesto por primera vez en la historia una amenaza para la humanidad. En estos últimos meses hemos visto la carrera por crear la IA más poderosa entre las grandes empresas multinacionales como Meta, Microsoft y Google. Durante la implementación de esta herramienta en todos los campos posibles, han aparecido numerosas voces de alarma entre sus principales desarrolladores. Existe un temor real de que esta tecnología pueda desequilibrar el mercado laboral mundial, o mucho peor, dar lugar a dictaduras digitales, ciberterrorismo e incluso nuestra extinción. Pero los esfuerzos por limitar la disrupción de la IA y crear un protocolo de regulación, parecen lentos e incapaces de controlar la situación. La pregunta es si habremos aprendido de nuestros errores del pasado, o vamos hacia el mismo destino. En cualquier caso, es el momento de reflexionar sobre el camino a seguir, enfrentándose a las incertidumbres que se avecinan.

Los usos potencialmente catastróficos

La energía atómica supuso una oportunidad para crear energía en cantidades exorbitantes, que mediante centrales nucleares es capaz de suministrar electricidad a ciudades enteras. Pero mucho antes de recurrir al uranio como fuente de energía, la humanidad se centró en su uso para desarrollar un arma sin precedentes. Como en otros momentos clave de la historia, el esfuerzo bélico fue capaz de crear avances tecnológicos que perduran hasta hoy. Pero a diferencia de otros inventos, las cabezas nucleares tenían un potencial catastrófico sin igual. A pesar de conocer su capacidad de destrucción a la perfección (reiteradas veces en la práctica) la humanidad se dedicó a crear cada vez más armas de destrucción masiva. La segunda mitad del siglo XX se caracteriza por la creación de miles de misiles con un poder de destrucción cada vez mayor, solo para evitar la guerra mediante la destrucción mutua asegurada. Desde luego, en cuanto a eficiencia y optimización de recursos, es una estrategia pésima la que siguieron las principales potencias mundiales.

De forma similar, la IA permite que una gran cantidad de tareas puedan automatizarse, y esto puede resultar en un enorme crecimiento económico. Ya estamos viendo como los chatbots son capaces de realizar muchas funciones igual o mejor que los humanos. Pronto serán capaces de superar la capacidad de los humanos (según Elon Musk en unos 2 años). Cuando las máquinas sean capaces de realizar tareas complejas mejor que nosotros, habrá un cambio de paradigma global, que repercutirá incluso en el contrato social. Pero ahora tenemos la oportunidad de prepararnos para este escenario, y evitar que los usos más terribles sean posibles. Mediante la legislación, ya se está luchando por crear un marco regulatorio que pueda adaptarse al cambio que estamos viviendo. Pero las voces críticas son por el momento aisladas, y requieren una plataforma global para poder llevar a cabo unas medidas efectivas.

Necesidad de cooperación

En el caso de la bomba atómica, el principal fallo fue la ausencia de una cooperación internacional real y efectiva. Los científicos como Oppenheimer defendieron la transparencia y el diálogo sin éxito, en algunos casos sacrificando su reputación. No fue hasta varias décadas después, y la producción de miles de bombas que se crearon mecanismos internacionales para frenar la proliferación de las armas nucleares. Si desde un inicio se hubiese puesto el conocimiento atómico en común y se hubiesen regulado de forma efectiva la creación de estas armas, muchos de los conflictos se habrían evitado. Y ahora parece que tenemos una oportunidad de tomar las decisiones adecuadas con respecto a la IA. Por un lado, empresas como Meta con LLama-2 están apostando por el código abierto y así compartir sus avances con toda la sociedad. Esto es un primer paso para evitar una guerra fría con el desarrollo de proyectos secretos y espionaje a gran escala. Una importante diferencia en este caso es que las entidades detrás del desarrollo de la nueva tecnología son principalmente empresas multinacionales. Por ello, los estados deben actuar de forma conjunta para regular las actividades de estas empresas en todo el planeta, no solo en su territorio (como es el caso de Italia).

El 30 de mayo se publicó un comunicado firmado por los principales desarrolladores de IA del mundo, incluidos los CEOs de OpenAI y Google Deep Mind. Se trataba de una advertencia que decía: “Mitigar los riesgos de extinción que supone la IA debería ser una prioridad global junto con otras amenazas como las pandemias y la guerra nuclear”. A principios de año hubo otro manifiesto también con muchas firmas, incluida la de Elon Musk, que alzaba la voz sobre la necesidad de paralizar la investigación durante 6 meses. Vemos como han pasado varios meses y no parece haber ninguna reacción a gran escala para responder a las preocupaciones de las mentes detrás de la IA. Lejos de ser apocalípticos, los desarrolladores y las empresas buscan encontrar la manera de solucionar las amenazas que supone esta tecnología y lograr una implementación segura en la sociedad.

Igual que en los momentos álgidos de la guerra fría, el Doomsday Clock o Reloj del Apocalipsis, es una representación que nos sirve para medir lo cerca que nos encontramos de una catástrofe mundial. El fin del mundo es la media noche, y dependiendo de lo cerca que esté el reloj de ese punto, menos márgen de maniobra existe para evitar un desenlace terrible. Actualmente, se encuentra en el punto más crítico desde su existencia, a 90 segundos de la media noche. Los expertos hablan de un punto de riesgo sin precedentes, combinando la guerra de Ucrania, la irrupción de la IA y el cambio climático. Igual que en 1945, estamos ante una lucha contrarreloj para tomar las decisiones adecuadas y lograr que la humanidad pueda sobrevivir. Más allá de los escenarios extremistas de extinción, también están en juego las libertades, la democracia, la igualdad y la justicia globales. Pero por primera vez, la IA tiene el poder de ser la causa y la solución de los principales retos a los que nos enfrentamos. Todavía está en nuestras manos.